第一作者:王纪武(1970—),男,辽宁辽阳人,副教授,博士.研究方向为深度学习、图像处理.email:jwwang@bjtu.edu.cn.

为了解决复杂图像背景条件下高压塔上鸟巢检测的问题,提出一种基于Faster R-CNN的多尺度高压塔鸟巢检测方法.在特征提取方面,通过改进基于卷积神经网络的ResNet-50特征提取网络分别完成图像中高压塔和鸟巢的特征提取;在建议区域提取方面,提出在两种不同深度的卷积特征图上采用合理尺度的不同大小滑动窗口方式完成建议区域的提取,增强了对鸟巢的检测能力;在目标检测方面,提出在高分辨卷积特征图上进行上采样操作,并额外增加SENet特征增强模块,有效提高了目标检测效果.最后利用同时检测出的高压塔区域条件剔除了此区域之外的鸟巢检测结果,进一步提升了最终的鸟巢检测精度.该方法在2 000幅无人机实际巡检航拍的含有鸟巢的图像数据集上进行了测试.实验结果表明:本文方法的平均检测精度达到了84.55%.对比已有的基于HOG+SVM的检测方法和基于经典的Faster R-CNN ResNet-50检测方法,本文所提出的方法平均检测精度分别提高了43.5%和15.2%,并加快了检测速度.该方法为无人机电力智能巡检提供了一种新的解决办法.

In order to solve the problem of bird’s nest detection on high-voltage towers using images with complex backgrounds, a general method of bird’s nest detection in multi-scale on high-voltage towers based on Faster R-CNN is proposed in this paper. In the aspect of feature extraction, the feature of high-voltage towers and bird’s nests in the image are extracted by the improved ResNet-50 network. In the aspect of region proposal, it is proposed to use sliding windows of different sizes and reasonable scales to gain region proposals on two convolution feature maps with different depths, which enhances the detection ability of bird’s nest. For the object detection, with the help of an upsampling layer is added to the feature maps with high-resolution and SENet feature enhancement module is added to the ResNet network, the proposed method achieves excellent results. Finally, the bird’s nest detection precision is further improved by simultaneous detection of high-voltage towers. The method is evaluated on a data set composed of 2 000 images containing bird’s nests which are sampled by unmanned aerial vehicle during actual inspection. The experimental results show that the average detection precision of this method reaches 84.55%. Compared with the existing detection methods based on HOG+SVM or classical Faster R-CNN ResNet-50, the average detection precision of the proposed method is improved by 43.5% and 15.2% respectively, and the detection speed is accelerated. This method provides a novel solution for intelligent inspection of UAV power system.

近年来, 随着我国高压架空输电线路的不断扩大, 高压塔上由鸟害引起的事故也更加频繁[1, 2].给电力系统的运行构成了严重威胁, 也给居民的正常供电安全生活带来了不便.因此, 为了保证输电系统的安全运行, 利用无人机巡检实现复杂图像背景条件下鸟巢的准确检测, 是智能化输电线巡检故障检测系统中一个亟待解决的难题.然而基于航拍图像的异物检测算法仍然面临着诸多挑战:如复杂图像背景下的目标遮挡和光照强度变化等对准确检测出输电线路中的异物带来了巨大的挑战.

当前输电线路系统异物检测算法中, 主要针对有特定形状, 并且颜色明显异于图像背景的异物有不错的检测效果, 而对于鸟巢这种边缘不规则、体积较小和颜色特征不稳定的异物检测效果不理想, 误检和漏检情况非常严重.最近, 有学者也对高压塔上鸟巢的检测有了初步研究, 文献[3]提出首先利用图像中铁塔是由不同方向的线材构成的, 将巡检图像分块并分析不同方向的线段密度, 然后采用聚类的方法将分块铁塔区域聚类来识别出铁塔区域, 最后利用鸟巢的颜色和纹理特征在铁塔区域内完成对鸟巢的检测.文献[4]提出运用局部动态阈值二值化和张细化算法等传统图像处理方法粗略得到疑似鸟巢的关键区域, 然后提取方向梯度直方图(Histogram of Oriented Gradnie, HOG)特征, 再通过支持向量机(Support Vector Machine, SVM)分类器进行精确提取, 自动甄别出鸟巢区域.文献[5]提出通过提取高压塔的HOG特征, 然后建立Gentle Adaboost级联分类器和跟踪相结合的粗精搜索策略完成图像中高压塔的准确定位, 最后利用鸟巢的颜色特性在候选区域中实现鸟巢的检测.

上述研究方法主要结合模式识别和传统图像处理技术实现了输电线路高压塔上鸟巢的检测, 也取得了进展性的检测效果.但是, 已有检测方法只有在航拍图像背景较为简单, 光照条件较为稳定, 鸟巢的位置比较显著等较良好的实验条件下有较好的检测效果, 没有充分考虑到实际应用中诸如遮挡、光照强度变化等复杂环境对高压塔上鸟巢检测所造成的影响, 因此距离实际中无人机巡检鸟巢自动检测应用差距较大.

为了解决复杂背景下现有方法不能对输电线路高压塔上鸟巢进行有效检测的问题, 通过分析大量实际航拍图像, 发现鸟巢一般坐落在高压塔横担位置, 因此本文作者提出一种基于Faster R-CNN[6]的多尺度高压塔鸟巢检测方法, 提出在两种不同深度卷积特征图上采用不同大小的合理滑动窗口方式实现建议区域的提取, 并在高分辨卷积特征图上进行上采样操作, 以及额外增加SENet特征增强模块有效提高了目标检测效果, 最后利用同时检测出的高压塔区域条件剔除了此区域之外的鸟巢检测结果, 进一步提升了鸟巢检测精度.该方法为实现当前基于无人机巡检的异物自动检测提供了可靠依据.

有效提取目标特征是图像目标检测的关键步骤.当图像背景简单且目标特征明显异于背景时, 利用传统的手工特征, 如几何特征和颜色特征等就可以获得不错的检测效果.但是在2D的无人机航拍图像中鸟巢与复杂的背景内容(山川、稻田、树木、陆地等)叠加在一起, 另外还受到航拍角度、距离、光照和遮挡等复杂因素的影响, 使得鸟巢自身的潜在特征具有较大的变化, 这些干扰因素使得仅依靠传统的手工特征提取技术很难准确实现高压塔上鸟巢的检测需求.卷积神经网络具有很强的抗环境干扰能力, 善于挖掘图像目标数据的局部特征, 并且可以利用自身特有的共享机制大幅减少要学习的参数数目, 能有效提高网络训练性能.基于卷积神经网络所获取的特征相比手工特征更加抽象, 表达能力更加健壮.本文通过对基于卷积神经网络的ResNet-50[7]模型进行改进来完成对高压塔和鸟巢的特征提取, 相比AlexNet[8], GoogLeNet[9]等特征提取网络, 其特点如下:

1)ResNet加入了Batch Normalization层, 对网络每一层输入数据做了均值为0方差为1的归一化处理, 有效解决了深层网络梯度弥散问题, 同时加快了网络训练收敛速度.

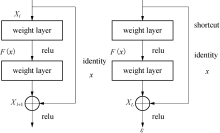

2)ResNet采用全新的“ shortcut” 恒等映射网络连接方式.如图1所示, 由于shortcut的加入使得式(4)中的梯度值可以通过“ 1” 流回任意浅层l, 避免了经过weight layer造成的梯度弥散问题, 使得网络的性能一直处于最优状态, 再不会随着网络深度的增加而降低.

Xl+1=Xl+F(Xl, Wl)(1)

式中:Xl为网络输入值, Xl+1, Xl+2, …, XL, ε 分别为网络输出值; F(Xl, Wl), F(Xl+1, Wl+1) , F(Xi, Wi)分别网络残差块.

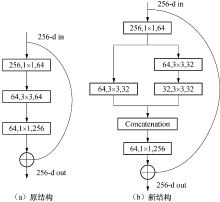

3)ResNet结构, 在层数较高时减少了3× 3卷积个数, 采用“ Bottleneck design” 网络设计方式.如图2(a)所示, 使用1× 1的卷积控制了3× 3卷积的输入输出特征图数量, 使得在增加网络深度和宽度的同时大幅降低了卷积参数的个数和计算量.

为了实现多尺度卷积特征提取效果, 本文提出如图2(b)所示的ResNet变体网络结构设计方式.这样的设计, 能使网络中每一层都能学到稀疏或不稀疏的特征, 既增加了网络的宽度, 也增加了网络对尺度的适应性.同时, 使用2个3× 3的卷积代替了一个5× 5的卷积, 既可以获得相同的视野, 还减少了参数.可得对比改进前后两种特征提取网络结构训练所需的权重参数数量分别为256× 1× 1× 64+64× 3× 3× 64+64× 1× 1× 256=69632; 256× 1× 1× 64+64× 3× 3× 32+(64+32)× 3× 3× 32+64× 1× 1× 256=78848, 可以发现两种结构设计方式在训练参数上相差不大, 但后续实验结果表明, 本文提出的ResNet变体结构对目标的检测精度有明显的提升.

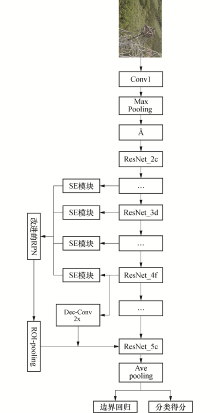

采用改进后的ResNet-50模型分别提取高压塔和鸟巢特征并进行特征可视化.为方便观察, 如图3所示, 仅选取前64维特征图进行显示.可以看出, Conv1层提取的是图像目标的低层特征, 如高压塔和鸟巢的边缘信息, 随着网络层数的加深, 可以提取到更高维的特征, 如鸟巢的纹理特征等.当达到ResNet_5c层时, 网络学习到的则是完整的具有可区分性的关键特征, 如图3(b)所示.这些特征具有很强的目标特征表达能力, 可作为目标检测分类的显著性特征.

Faster R-CNN算法首先通过建议区域提取网络(Region Proposal Network, RPN)获得含有前景目标的高质量建议框并对目标建议框位置进行了初步修正, 然后送入目标检测子网络进一步实现了目标建议框特定类别的判断和位置的精调.因此相比于舍弃建议区域提取直接基于回归的YOLO[10]和SSD[11]目标检测算法, Faster R-CNN算法本身的鲁棒性会更强一些.但是, 文献[6]中目标建议区域是在ZF网络或VGG16网络的最后一层卷积层上获得的, 由于该层卷积特征图分辨率较低, 导致对小目标的检测能力不足.因此, 针对上述问题, 本文提出采用分层多尺度的建议区域提取方案替代原RPN网络中利用锚框机制提取建议区域的方式, 将建议区域的提取扩展到ResNet-50的多个卷积层上.如图4所示, 分别在卷积层ResNet_3d和ResNet_4f上滑动不同尺寸的窗口, 将每一个滑动窗口在原图中对应的映射区域作为初始建议区域.之后, 参考Faster R-CNN中RPN网络的定义得到每个滑动窗口区域对应的置信度和边界框回归参数.对于卷积层ResNet_3d, 该层卷积特征图分辨率较高, 相比于之后的卷积层对小目标的响应更强, 主要用于提取输入图像中目标占图像比非常小的目标.为了满足不同尺度小目标的检测需求, 此层分别采用大小为3× 3、5× 5和7× 7的3种滑动窗口尺寸.同时, 为了提高检测速度, 设置三种滑动窗口的步长均为2; 对于卷积层ResNet_4f, 主要用于提取中大型尺度的目标, 这里分别采用大小为7× 7、9× 9和11× 11的三种滑动窗口尺寸, 并设置滑动窗口的步长为1.对于目标检测子网络, 本文选择分辨率更高的ResNet_4f作为目标建议框的特征映射层, 然后通过ROI-pooling后送入后续网络中实现目标的特定类别判断和位置回归.为了测试时对小目标也具有更强大的表征能力, 本文对ResNet_4f卷积特征层增加一个上采样层来进一步提升特征图的分辨率.

SENet[12]提出卷积特征图包含多个通道, 每个通道对于最终的目标检测效果的贡献不一致, 通过增加有效通道抑制无效通道特征的方式可以增强特征, 进而可以显著提高目标检测的准确率.为了均衡检测精度与速度的要求, 本文只对检测效果影响最大的ResNet_3卷积层组和ResNet_4卷积层组进行特征增强操作.

为了加快RPN网络的训练速度, 本文提出联合ResNet_3d和ResNet_4f两层卷积特征图上映射的建议区域实现对训练集和测试集上建议区域的提取.分别对每个滑动窗口对应的初始建议区域进行样本标注.当某个初始建议区域与某个真实目标标注框有最大交并比(Intersection-over-Union, IoU), 或者与任意一个真实目标标注框的最大的交并比IoU> 0.6时, 将该建议区域标定为正样本; 当IoU小于0.3时, 则定为负样本; 未被标记的初始建议区域在训练过程中不会对目标函数造成影响.其中RPN网络损失函数与网络总损失函数分别沿用Faster R-CNN和Fast R-CNN中的损失函数公式.整个目标检测网络利用反向传播和随机梯度下降法进行端到端的训练.

考虑到网络训练阶段, 由于负样本数量较多且分布不均匀, 可能会对网络模型的训练损失函数产生较大振荡, 因此本文选择根据初始建议区域与真实目标标注框之间的IoU值, 对所有负样本进行排序, 并从中挑选IoU值最高的部分样本作为负样本加入训练集.

对于一张分辨率为1000× 600的输入图像, 通过本文改进的RPN方法进行建议区域提取后, 得到大约12 000个初始建议区域.然而, 这些建议区域之间会存在大量的重叠, 严重影响检测的速度.因此, 本文基于初始建议区域的置信度值大小, 采用非极大值抑制(Non-Maximum Suppression, NMS)的方法对其数量进行精选.在进行非极大值抑制时, 设置IoU的阈值为0.7, 从而每张图像大约只剩下1 000个建议区域.随后, 从剩余的1 000个建议区域中挑选置信度最高的100个作为最终的目标建议区域, 并对其进行ROI-pooling操作后送入后续的卷积特征提取层和目标检测子网络中.

同时为了减少网络训练参数, 提高网络模型的整体检测性能, 检测部分沿用ResNet经典网络中的平均池化方式替代传统的全连接方式实现目标的分类检测和边界框回归.

为了丰富图像训练集, 更好的提取图像目标特征, 提高模型的检测能力.本文首先使用图像增强技术(图像翻转、旋转、增加对比度等)对图像数据集进行扩充.该样本库中不仅包含普通复杂背景下的图像, 还包括目标物受光照、遮挡、雾天等严重干扰的图像.然后将图像样本的尺寸统一缩放至1000× 600, 并对图像中高压塔和鸟巢的位置和标签分别进行标注, 使其符合Pascal VOC的标准数据集格式.最后将样本库中的图像按照3:1的比例分为两组, 训练集为9 000张, 其中包含鸟巢的样本有6 000张; 测试集为3 000张, 其中包含鸟巢的样本为2 000张.样本库中所有图像均包含高压塔.

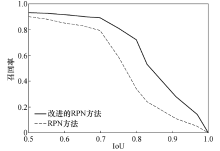

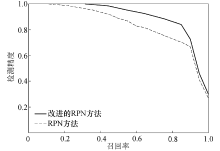

在构建的高压塔和鸟巢数据集上, 针对本文改进的RPN建议区域提取方法与Faster R-CNN经典的RPN建议区域提取方法进行实验测试对比, 将不同IoU阈值下对目标的召回率以及P-R(Precision-Recall)曲线结果作为评估准则.由图5可知, 当IoU阈值为0.5时, RPN方法和本文改进的RPN方法都具有很高的召回率, 并且如图6所示, 对应高召回率下, 两种方法对应的检测精度也均处在基本相同的偏低位置; 但当IoU阈值超过0.7时, 本文改进的RPN方法依然有较理想的召回率, 并且如图6所示, 对应召回率下的检测精度也保持在一个较高的状态.而RPN方法对应的召回率却发生骤减, 并且相比之下, 其检测精度也相对较低一些.从而表明本文提出的建议区域提取方法相比经典的RPN方法更加精确, 其主要原因有两方面:1)经典的Faster R-CNN网络模型采用RPN网络产生建议区域, 这种方法针对小目标提取的建议框精度不够高; 2)RPN网络通常只在最后一层卷积特征图上提取建议区域, 由于此层对应的特征图分辨率较低, 对小目标的检测能力有限.而本文针对目标自身的尺度通过在不同卷积特征图上设计了合理的不同大小滑动窗口, 因此提取的建议框精度更高.

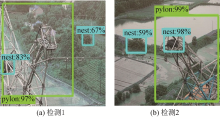

为了减小图像中高压塔矩形框之外的复杂背景对鸟巢检测结果的影响, 如表1所示, 对本文方法的检测结果进行了分类判断, 通过剔除高压塔矩形框之外的鸟巢检测结果, 可以有效降低鸟巢误检情况的概率, 进一步提高了鸟巢的检测精度.图7展示了部分基于高压塔矩形框条件下的样本检测结果.

| 表1 鸟巢检测结果分类 Tab.1 Classification of bird’ s nest detection results |

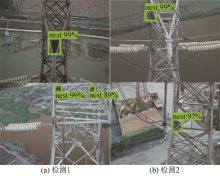

表2比较了本文方法与已有的鸟巢检测方法, 以及传统的Faster R-CNN ResNet50方法在相同数据集上的表现.使用平均检测精度(Average Precision, AP)和均值平均检测精度(mean Average Precision, mAP)两种性能指标对比.其中已有的鸟巢检测方法参考文献[2]提出的基于HOG特征+SVM分类器的鸟巢检测方法.从平均检测精度上, 本文方法相比基于机器学习的目标检测方法, 有接近一倍的大幅提升.而相比于传统的Faster R-CNN ResNet-50方法, 在鸟巢检测上有15.2%的提升, 在高压塔检测上有6.5%的提升, 验证了本文方法在小目标检测上的显著优势.同时, 在检测速度上, 也稍快于Faster R-CNN ResNet50方法.图8展示了本文方法在部分测试集上的鸟巢检测结果.

| 表2 测试集上的鸟巢检测结果对比 Tab.2 Comparison of bird’ s nest detection results on test set |

为了进一步验证本文方法的检测性能, 在目标数据集上额外进行了网络模型分解实验, 具体分析了本文提出的多种网络设计方法对检测结果的影响.表3为网络模型分解实验结果对比.

| 表3 网络模型分解实验结果对比 Tab.3 Experimental results of network model decomposition |

从表3的网络模型分解实验结果可以看出, 若不同时使用ResNet_3d卷积层和ResNet_4f卷积层来提取建议区域, 鸟巢平均检测精度将下降6.3%; 将SE模块分别嵌入到ResNet_3卷积层组和ResNet_4卷积层组中可以将鸟巢平均检测精度提升4.8%; 使用改进的ResNet-50网络设计方法能够将鸟巢平均检测精度提升2.7%; 最后通过在ResNet_4f卷积特征层上使用反卷积操作可以将鸟巢平均检测精度提升1.4%.

针对无人机实际巡检航拍图像, 采用基于Faster R-CNN的多尺度高压塔鸟巢检测, 结论如下:

1)改进的基于卷积神经网络的ResNet-50特征提取网络设计, 可以充分提取到高压塔和鸟巢的关键特征.

2)根据检测目标自身尺度大小, 通过在不同卷积特征图上设计不同合理尺度滑动窗口的建议区域提取方法, 可以获得更高精度的初始建议区域.

3)通过网络模型分解实验结果, 得出本文设计的分层多尺度鸟巢检测网络框架具有很强的目标检测性能, 尤其是增强了对鸟巢这样的小目标检测能力.

4)通过在测试集上设计鸟巢检测对比实验, 验证了本文方法的高效性.实验结果表明, 鸟巢的平均检测精度达到了84.55%, 同时也加快了检测速度.

| [1] |

|

| [2] |

|

| [3] |

|

| [4] |

|

| [5] |

|

| [6] |

|

| [7] |

|

| [8] |

|

| [9] |

|

| [10] |

|

| [11] |

|

| [12] |

|